A NVIDIA publicou hoje um guia técnico detalhado ensinando usuários e desenvolvedores a rodar o OpenClaw em GPUs RTX e no sistema de alto desempenho DGX Spark. O OpenClaw é um agente de IA “local-first” que atua como um assistente pessoal contínuo, capaz de acessar e-mails, arquivos e calendários sem que os dados precisem sair da máquina do usuário.

A grande vantagem dessa abordagem é a privacidade absoluta aliada ao desempenho massivo dos Tensor Cores presentes nas placas GeForce RTX e NVIDIA RTX, garantindo respostas rápidas para fluxos de trabalho agentivos.

Passo a Passo para Configurar o OpenClaw Localmente

De acordo com o guia da NVIDIA, a configuração utiliza o WSL (Windows Subsystem for Linux) para criar um ambiente robusto. Os usuários podem utilizar ferramentas populares como LM Studio ou Ollama para gerenciar os modelos de linguagem (LLMs).

A escolha do modelo depende diretamente da memória de vídeo (VRAM) disponível na sua placa:

| Hardware | Memória (VRAM) | Modelo Recomendado |

| GeForce RTX 3060 / 4060 | 8GB – 12GB | Modelos de 4B a 7B parâmetros |

| GeForce RTX 3090 / 4090 | 24GB | Modelos de 13B a 30B parâmetros |

| NVIDIA DGX Spark | 128GB | gpt-oss-120B |

Vantagens da Execução Local com CUDA

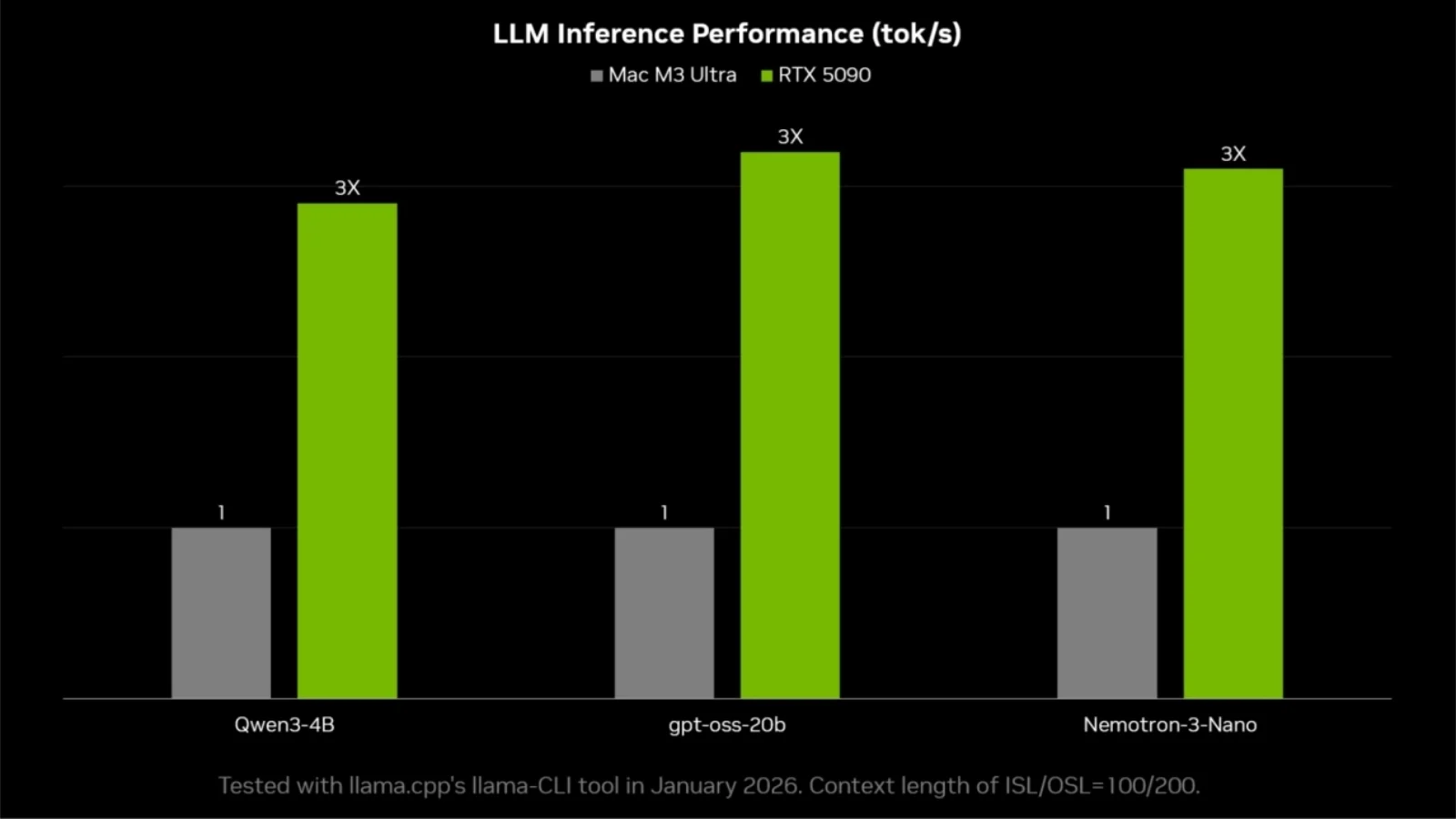

Ao rodar o OpenClaw em GPUs RTX, o sistema utiliza a arquitetura CUDA e bibliotecas como Llama.cpp para acelerar a inferência. Isso significa que tarefas como resumir e-mails longos, gerenciar compromissos e realizar pesquisas complexas em arquivos locais acontecem quase instantaneamente, sem a latência típica de serviços baseados na nuvem.

O Que Você Pode Fazer com o OpenClaw?

Diferente de um chatbot comum, o OpenClaw foi projetado para ser proativo. Com ele configurado corretamente em sua GPU NVIDIA, você pode:

- Automatizar Redação: Criar respostas de e-mails baseadas no seu histórico local.

- Gestão de Projetos: O agente acompanha prazos e gera relatórios de pesquisa cruzando dados da web com seus documentos pessoais.

- Assistente Pessoal 24/7: Como roda localmente, o custo de operação é zero e a disponibilidade é constante.

Para os interessados em máxima performance e privacidade, a NVIDIA disponibilizou o guia completo em seu blog oficial, reforçando o compromisso de tornar a IA acessível e segura para o usuário final.

Quer saber mais sobre como otimizar sua placa de vídeo para IA ou conferir os melhores modelos de LLM para 12GB de VRAM? Continue acompanhando nossas atualizações de hardware.